人工智能伦理的复杂性:社会影响的全面探索 (人工智能伦理道德问题)

人工智能(AI)以其变革各行各业的潜力而闻名,但随之而来的还有其伦理影响的复杂性。人工智能技术的发展引发了众多伦理问题,需要我们仔细考虑和解决。

偏见和歧视

人工智能系统经常使用数据训练,这些数据可能包含偏见和歧视。因此,人工智能系统可能会从训练数据中学到这些偏见并将其反映在决策中。例如,用于招聘的AI系统可能会基于不相关的因素,如性别或种族,做出有偏见的决定。

プライバシーへの影響

人工智能系统需要大量数据来进行训练和操作。这需要收集和分析大量的个人数据, مما قد يؤدي إلى مخاوف بشأن الخصوصية. يمكن لسوء استخدام بيانات المستخدم أن يقوض الثقة في الأنظمة التي تعتمد على الذكاء الاصطناعي ويضر بحقوق الأفراد.

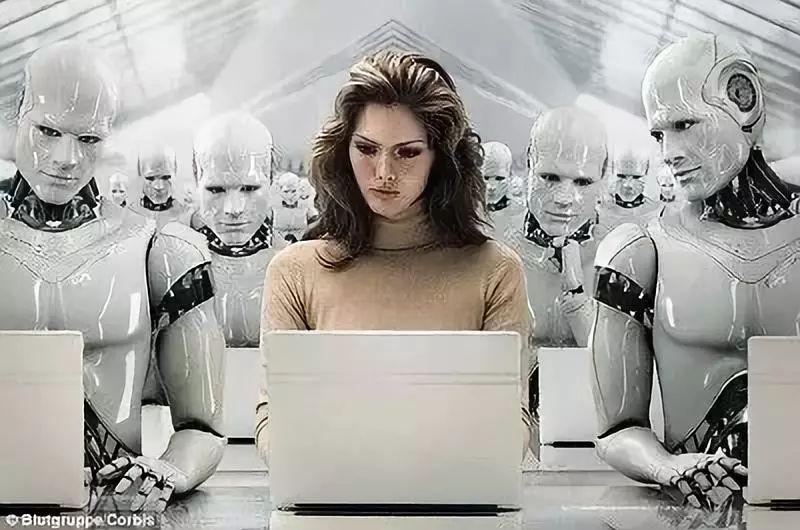

自动化和就业

人工智能正在越来越多地自动化任务,从而取代人类工人。虽然这可能会提高效率和生产力,但它也对就业市场产生了重大影响。需要考虑如何重新培训和安置因自动化而失业的工人。

责任与问责制

当人工智能系统做出有害决定时,很难确定责任。人工智能系统通常是复杂的,由多个参与者开发和部署。确定谁应对错误决策负责可能是一个挑战。

潜在的社会利益

尽管存在挑战,人工智能技术也具有许多潜在的社会利益。例如,人工智能可以帮助改善医疗保健、教育和交通运输。它还可以用于解决气候变化和社会正义等社会问题。

解决人工智能伦理问题的原则

为了解决人工智能伦理难题,有必要建立一套指导原则。这些原则应包括:

- 公平和公正:确保人工智能系统以公平、公正的方式处理所有人。

- 透明度和可解释性:确保人工智能系统可以理解,并解释其决策背后的原因。

- 责任和问责制:明确确定人工智能系统决策的责任和问责制。

- 尊重隐私:保护个人数据,防止滥用。

- 人类中心:确保人工智能技术以对人类有益的方式开发和部署。

结论

人工智能伦理是一个复杂且多方面的领域,需要仔细考虑和跨学科合作。通过解决偏见、隐私、就业和责任等问题,我们可以确保人工智能技术以符合人类价值观和利益的方式开发和部署。只有通过共同努力,我们才能充分利用人工智能的潜力,同时减轻其潜在风险。